Acercándonos al nirvana de la normalización del loudness

RTVE, en colaboración con la AES, ha organizado un Seminario dedicado a la normalización de loudness y el nivel máximo permitido de señales de audio, debatiendo sobre la aplicación de la recomendación EBU/UER 128-2010. Son ya tradición las quejas continuas de los espectadores por los saltos de sonido en la señal de audio entre canales o, incluso, dentro de un mismo canal entre la emisión de programas y la publicidad o promos. Ahora, parece haber cierto consenso entre industria, broadcasters y anunciantes para poner fin a esta incómoda práctica.

Jaime Gaiteiro, director General Corporativo de RTVE, Yolanda Marugán, directora del Instituto RTVE y Pere Vila, director de Planificación e Innovación Tecnológica en RTVE han abierto este jueves 24 de febrero en Madrid un Seminario, organizado por RTVE en colaboración con la AES y con una masiva asistencia de profesionales, dedicado a la normalización de loudness y nivel máximo permitido de señales de audio, debatiendo sobre la aplicación de la recomendación EBU/UER 128-2010.

Son ya tradición las quejas continuas de los espectadores por los saltos de sonido en la señal de audio entre canales o, incluso, dentro de un mismo canal entre la emisión de programas y la publicidad o promos. Ahora, son numerosos los grupos de trabajo que en todo el mundo están promoviendo para intentar avanzar en una materia que afecta por igual a televisiones, operadores y todo tipo de productoras. Precisamente el pasado 27 de enero, la Secretaría de Estado de Telecomunicaciones y para la Sociedad de la Información acogió la reunión constitutiva del nuevo Grupo de Trabajo sobre Audio en la Televisión Digital. Su objetivo pasa por adaptar las nuevas tecnologías de audio y promover su calidad en la televisión. Además, el grupo, coordinado por Pere Vila, trabajará en pro de la elaboración de documentos y guías de referencia para el sector sobre los aspectos de audio que se analicen.

Florian Camerer, presidente del grupo PLOUD de la UER y todo un experto miembro de la AES con larga trayectoria en el mundo del audio, ha abierto el turno de ponencias con una brillante exposición en la que ha dado a conocer la situación actual y los trabajos que desde la Unión Europea de Radiodifusión se están llevando a cabo en cuanto a normalización del loudness.

Camerer ha comenzado su intervención afirmando que «ha llegado la hora de emprender una revolución en el nivel de sonido para solucionar problemas».

«La recomendación EBU/UER 128-2010 nos está acercando al nirvana del loudness para evitar los saltos, y ahora tengo mucha confianza que nos estamos acercando a este paraíso del loudness para que los espectadores no tengan que estar continuamente utilizando el botón del volumen en su mando», ha afirmado.

La manera en la que estamos midiendo las señales condiciona esta situación ya que tomamos como referencia los picos o, mejor aún, los casi-picos (inferiores a 10 ms). Estos picos no se pueden ver bien en el medidor, pero sí se transmiten violando el margen de guardia debido a una compresión cada vez mayor en audio sacrificando todo el rango dinámico. Por ello, a juicio de Camerer, la compresión no es lo ideal para resolver los problemas del loudness con técnicas no para diferenciarse de la competencia por meter más ruido sino por ofrecer un audio más artístico.

Antes de 2006, no había estándar internacional sobre la medición de la sonoridad, una cuestión clave ya que el loudness es una impresión totalmente subjetiva. Encontrar un algoritmo que refleje esta subjetividad no era tarea fácil, aunque finalmente la ITU dio el primer paso con la recomendación internacional ITU-R 1770 introduciendo las medidas LU (Loundess Unit) y LUFS (Loudness Unit, referenciados a fondo de escala).

Posteriormente la UER, además de la sonoridad media de un programa (‘Programme Loudness’), recomendó que sean usados los descriptores ‘Loudness Range’ y ‘Maximun True Peak Level’ para la normalización de las señales de audio, para ajustarse a los límites técnicos en la totalidad de la cadena de señal así como las necesidades estéticas de cada programa/radiodifusor dependiendo del género y la audiencia objetivo.

Según Camerer, el uso normal de la lectura de los picos, «el QPPM (Quasi-Peak Programme Meter) especificado en la EBU Tech Doc 3205-E no refleja la sonoridad de una señal de audio y que el QPPM no está diseñado para medir una media de largo plazo». Además, la medición de la sonoridad del programa por umbral de puerta (gate) es favorable para mejorar la concordancia de la sonoridad de programas con un rango sonoro amplio.

Para la normalización de la sonoridad y niveles máximos permitidos desde la UER recomiendas que los descriptores Programme Loudness, Loudness range y Maximum True Peak Level sean utilizados para caracterizar una señal de audio. Por otro lado, considera que el Programme Loudness Level sea normalizado a un Target Level (nivel destino) de -23 LUFS. La desviación permitida del nivel destino no debería exceder generalmente de ±1 LU en los tipos de programas que no se pueda lograr una normalización exacta en la práctica como sería el caso de los programas en directo, por ejemplo.

Florian Camerer también ha hecho hincapié en que la señal de audio debería medirse en su totalidad, sin enfatizar elementos específicos tales como la voz, música o efectos sonoros llevando a cabo esta métrica con un medidor de sonoridad en conformidad tanto al documento ITU-R BS.1770 como al EBU Tech Doc 3341.

La UER también ha introducido lo que se ha dado en llamar método de umbral de puerta o gating fijando un umbral relativo de 8 LU por debajo del nivel de sonoridad no moderado LUFS especificado en la EBU Tech Doc 3342, lo que se denominaría el «factor G8» (que se introducirá modificado como valor G10 el próximo marzo en la ITU-R BS 1770).

Camerer ha afirmado que «la publicidad, por ejemplo, necesita una sonoridad viva y dinámica, por lo que lejos de acudir a una compresión debería atenderse más al diseño de audio de una producción».

La ORF austriaca en la que trabaja Camerer está tomando medidas en este contexto marcando un rango máximo por debajo de 20 LU en la emisión de películas y música clásica.

En cuanto a la medición, son ya más de 200 los fabricantes que están ofreciendo soluciones técnicas acorde a este nuevo contexto conforme tanto al documento ITU-R BS.1770 como a los documentos técnicos EBU 3343 y 3344. Mientras que los procesos de audio, sistemas y operaciones respecto a la producción e implementación deban ser realizados de acuerdo al 3343, los procesos de audio, sistemas y operaciones respecto a la distribución deberán estar acordes al 3344 (pueden descargarse en aquí).

Efectos sobre la ingeniería

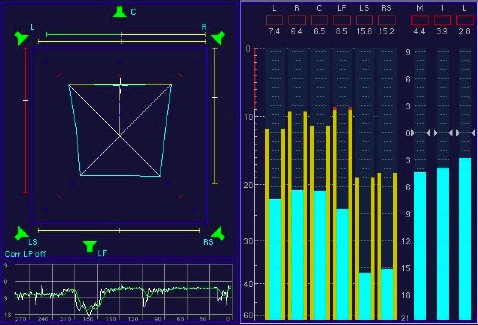

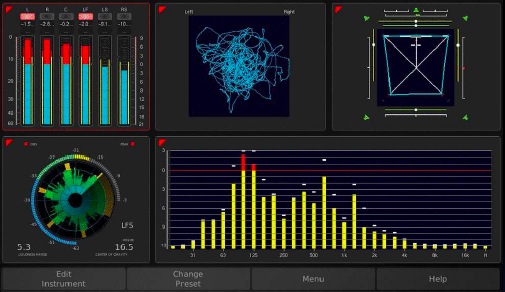

David Vivas, director técnico y responsable de la oficina de Madrid de Unitecnic, ha hecho un repaso sobre los efectos sobre la ingeniería de las instalaciones que supone la recomendación EBU R128 ya que introduce nuevos términos y nuevos modos en la medición de niveles de audio. La R128 afectaría a toda el flujo de trabajo desde la producción (tanto en móviles como en estudio), la postproducción, el playout (ingesta, emisión…), archivo… afectando en dos puntos: instrumentación de medición en producción, distribución y transmisión, y el cómo y con qué instrumentos realizamos el procesado de la señal de audio. También ha puesto en sobreaviso para que la ahora de adquirir un medidor responda a los requisitos propuestos en la recomendación.

Vivas entiende que «ya que la R128 recomienda el uso de un medidor de loudness en lugar del medidor de pico (QPPM), todos los puntos de monitorado de nivel de audio en la cadena broadcast deberían utilizar medidores de loudness. Esto no quiere decir que se abandone el uso del picómetro para saber qué nivel de decibelios tiene una señal, pero sí debería pasar a un segundo plano».

En entornos de producción, y dado que cada día se utiliza más audio embebido, además de medir en salida del mezclador de audio y de vídeo, se debería tener en cuenta el nivel de loudness tras pasar por el embebedor de programa antes de la emisión.

En post-producción, la práctica totalidad de los sistemas de audio están basados en software. Estos sistemas incorporan o pueden incorporar herramientas de medida basadas en software como funcionalidad del propio sistema o a modo de plug-in: VST,TDM…

En lo que a ingesta se refiere, Vivas ha recordado que la R128 recomienda trabajar con un nivel de audio en programa de -23 LUFS por lo que los contenidos que llegan a las áreas de ingesta deberían estar dentro de este parámetro.

Para playout, en caso de trabajar con ficheros (ingestados o recibidos vía red desde el exterior), estos podrían no tener el audio normalizado a -23 LUFS, solucionándose gracias a las herramientas existentes que normalizan el audio al nivel requerido trabajando directamente con los ficheros. En emisión, toda la cadena debe contar con sistemas que nos permitan medir el nivel de sonoridad en cada punto del workflow.

Vivas ha señalado que «sería interesante el uso de equipos que nos permitan hacer logging del nivel de sonoridad de nuestra emisión en el tiempo. Estos datos de logging pueden cruzarse con los datos de ‘as run log’ del sistema de automatización de emisión para registrar el nivel de sonoridad de nuestra emisión». Sobre el uso de los procesadores dinámicos en emisión, David Vivas ha recordado que deberían ajustarse como salvaguarda conforme a la recomendación.

Los broadcasters

Luis Santillana, responsable de Tecnología Audiofrecuencia de RTVE, ha afirmado que «inmersos en la HDTV donde se consigue un mayor impacto en la comunicación por una concepción espacial del sonido, en RTVE nos estamos planteando un impulso para el desarrollo e implementación de nuevas prestaciones en equipamiento de audio, la gestión de los 16 canales que nos permite una trama de SDI utilizando así todo su potencial, y el manejo no destructivo del entramado Dolby E para con menos canales meter más información y transportar audio multicanal con metadata específica del programa producido».

Santillana ha recordado que desde 2008, en RTVE los nuevos entornos de medida asociados a las mesas de audio en entornos de producción 5.1 tienen que incorporar medidas de loudness. Desde principios de 2010 los expedientes de adquisiciones pedían ya medición de sonoridad según la norma ITU BS 1770/71.Por otra parte, la corporación está llevando a cabo paulatinamente una adecuación de los sistemas y herramientas existentes para que los operadores puedan interpretar adecuadamente la sonoridad de los programas.

Miguel Ángel de la Torre, operador de sonido en Antena 3 Tv y director de Graudio Institute, ha analizado el papel del operador de sonido en este entorno cambiante. Considera que todos los operadores deberían respetar el margen dinámico (-23 LUFS con desviación de +/- 1 LU para programas en directo), garantizando además la mejor relación señal/ruido (con un máximo Peak Level de -1db) estableciendo por otro lado un correcto flujo de la señal en cuanto a cálculos y procesos con consolas digitales en coma flotante.

«La sonoridad se puede medir y podemos aplicar diferentes criterios dependiendo de factores como el contenido predominante, la franja horaria o el tipo de programa. Para obtener buenos resultados deberíamos contar con factores como la calibración correcta de las escuchas de estudio contando con los medidores de sonoridad adecuados tanto en controles de sonido, continuidades, control central y salas de VTRs, postproducción, ingesta… así como una optimización del control de dinámica y diseño de audio», ha destacado De la Torre.

Torre de Babel

Gabriel Solsona, responsable de la Unidad de Sonido de TVE, ha hecho un balance histórico recordando que «desde la aparición en 1939 del vúmetro, su intencionada inercia de medición hacía su mejor esfuerzo para reflejar la sonoridad percibida de la señal de audio. En los 80 se dio paso a la aparición del picómetro… pero todo ello fue derivando en la creación de una Torre de Babel con cada vez más formas de medición y cientos de escalas. Por un lado, ciertos centros de producción abandonaron el vúmetro por el picómetro, perdiendo de esta manera la ya débil referencia que se tenía de uniformar el nivel medio de sonoridad. Por otro lado, otros centros de producción no vieron hasta mucho más tarde un picómetro y quizás los menos, eran afortunados de tener ambos medidores».

Por otro lado, la publicidad entró en el juego de cara a penetrar en el consumidor, usando todas las herramientas que tenía a su alcance y no eran otras que los cada vez más y mejor elaborados compresores de dinámica o incluso algoritmos de proceso digital denominados maximizadores con menores artefactos o distorsión de la señal. «Este tipo de compresión no era detectable ni por los vúmetros ni por los picómetros; el primero, por su cada vez más patente alejamiento de lo que mide con respecto a lo que oímos y el segundo, porque no es su misión como medidor», ha afirmado Solsona.

Desde su punto de vista, la principal diferencia en el tratamiento de audio no vendría por el género sino por si un programa es postproducido o en directo. En el caso de los postproducidos, el objetivo es que la sonoridad del programa sea -23 LUFS. Para ello, según el programa es ensamblado es observa que la medición momentánea y la de corto plazo estén alrededor de 23 LUFS, a no ser que se quiera enfatizar o atenuar un pasaje. En cualquier caso, según Solsona, al final de la postproducción se debe realizar una medición integrada y comprobar que está a -23 LUFS. De no ser así, se solucionaría fácilmente mediante la atenuación o ganancia por una cantidad igual al offset que se presenta.

En directos, se necesitaría algo más de práctica de uso con el medidor y ser algo reservado para conseguir que el valor integrado que va en paralelo al programa, acabe en -23 LUFs con un margen de tolerancia de +-1 dB.

Por último, Gabriel Solsona ha concluido su intervención afirmando que es necesario una implementación global, ya que de no ser así, el problema de los saltos de sonoridad puede agravarse».

Postproducción

Carles Vila, director técnico en Media Arts Studio, ha hecho un repaso a los retos a los que se enfrenta la postproducción en ámbitos diferentes como el doblaje o la publicidad. Su primera conclusión es que muy pocos clientes son conscientes del concepto de sonoridad, siendo aún menos los que imponen una normativa sobre sonoridad. En doblaje, se ha actuado tradicionalmente equiparando el nivel del doblaje al nivel de la versión original.

Para lograr una uniformidad en todo el proceso, Vila ha señalado que es necesario una calibración de las salas de mezclas que permita mezclar y juzgar a oído confirmando que los niveles corresponden a los -23 LUPS.

Como estrategias para la normalización de sonoridad propone dos alternativas: mantener los hábitos de nivelación y aplicar ganancia o atenuación; o cambiar la normalización de sonoridad sin necesidad de desplazamiento… en ambos casos a -23 LUFS. Para la normalización durante la mezcla, podríamos acudir a un hardware dedicado (por ejemplo, TC Electronic TM-7) o a un software integrado en DAW (del tipo Nugen VisLM) aunque en cualquier caso la integración debe estar sincronizada con el transporte y ser una muestra post-fader.

Con respecto a la dualidad sonoridad vs. limitación «brickwall”, Vila ha concluido su ponencia sosteniendo que la limitación a -9 dBFS en una cadena de audio completamente digital es ahora arbitraria e innecesaria si nos adherimos a la R 128 ,y herencia de necesidades analógicas. «Partiendo de que la recomendación R128 propone limitar a -1 dBTP preventivamente, normalizando un audio origen a -23 LUFS (sin limitación), cualquier limitación posterior (p.ej. a -9) aumentará el valor de sonoridad en función de cuán intensa sea la limitación (umbral del limitador). Volver a normalizar a -23 LUFS post-limitación solo implica una pérdida de margen dinámico innecesaria», ha enfatizado.

Por su lado, Nacho Legorburu, director de Audio Spot Sonido Digital, ha iniciado su ponencia afirmando que «la audiencia está cansada de sobresaltarse y estar modificación el volumen de su televisor. Y esta situación tiene que acabar para que no impere la ley del más fuerte en los cortes publicitarios».

«Hemos creado fatiga auditiva y hartazgo en el zapping…y ésta es la mejor receta para que se deje de ver televisión y publicidad», ha sentenciado Legorburu.

También ha hecho un repaso a algunas de las acciones desarrolladas en Audio Spot para garantizar la calidad en todo el workflow en postproducción de audio.

Este seminario sobre normalización loudness ha concluido con la petición generalizada de que lo que hoy es solo una recomendación de la EBU se convierta en normativa para proteger al espectador de la agresión sonora y evitar posibles desventajas entre broadcasters que ajusten su nivel máximo al recomendado y otras que no lo hagan.

10 cosas que hay que saber sobre la sonoridad

1. Sonoridad es el nivel del sonido que la gente «oye»

Es lo que siempre hemos llamado «volumen». Sonoridad hace referencia a la intensidad percibida de una pieza sonora (música, locución, efecto de sonido…) Depende del nivel, frecuencia, contenido y duración del audio, entre otras cosas.2. Los telespectadores y radioyentes se quejan de los saltos de sonoridad

La publicidad, en particular, y los intersticiales, en general, son desafortunadamente famosos por su gran nivel de compresión y su alto nivel de reproducción.3. Los medidores de pico de sonido actuales no reflejan la sonoridad

La medición de audio en la radiodifusión actual se basa en la medición de los picos de programas (PPMs). Mejorar la medición del sonido mediante la adición de un medidor de sonoridad es acercarse un paso hacia la mejor herramienta de medición: el oído humano.4. El rango dinámico ha disminuido drásticamente debido a la «guerra de la sonoridad»

La medición de pico ha fomentado la potencia del procesado del rango dinámico con el propósito de conseguir que un elemento radiodifusor fuese más sonoro que la competencia.5. La dinámica de sonido es una herramienta creativa

La compresión de rango dinámico debe ser usada únicamente por razones artísticas. Mediante la adopción de la medición de la sonoridad y su normalización, la producción de audio puede esperar nuevamente el uso de la dinámica como una herramienta creativa.6. Se puede poner paz a la guerra de sonoridad cambiando la referencia

La competición debe estar en el contenido y en la calidad del sonido.7. La normalización de la sonoridad da la solución

La solución es cambiar el esquema y mezclar a un nivel de sonoridad común.8. Existe un estándar de medición de sonoridad: ITU-R BS.1770

9. -23 LUFS, un número mágico

Éste será el nivel de sonoridad medio de cualquier programa, publicidad o intersticial. Esto es compatible con la libertad de rango dinámico como elemento de expresión artística. De hecho, el nivel máximo de pico sube hasta -1 dBTP10. La sonoridad normalizada tiene que ser el estándar de toda la cadena de radiodifusión

El problema de la sonoridad no puede ser solucionado solo por los radiodifusores o por los fabricantes de equipos. La normalización de la sonoridad debe ser abordada por el conjunto de actividades de la producción, continuidad, distribución y reproducción.

¿Te gustó este artículo?

Suscríbete a nuestro NEWSLETTER y no te perderás nada.