多模态处理:人工智能改变广播的真正潜力

José Carlos González, director de IA y Julio Albertos, data scientist, ambos parte de la consultora especializada en inteligencia artificial Dive, explican cómo el procesamiento multimodal replantea procesos y abre la puerta a importantes posibilidades creativas y operacionales.

La IA se ha ido abriendo paso en los procesos de los broadcasters españoles. La cautela de hace apenas unos años, con responsables técnicos escudándose en la responsabilidad colectiva y subrayando su compromiso con el trabajador humano, ha sido sustituida por una euforia colectiva tras los notables resultados de ciertas herramientas.

Frente a otros sectores que implementan esta serie de tecnologías con una cautela propia de lanzarse a lo desconocido, en el broadcast la IA no deja de ser una evolución de un concepto sobradamente extendido en los ecosistemas audiovisuales: la automatización. Una automatización más inteligente y casi predictiva, sí, y acompañada con una generación automática basada en ingentes volúmenes de datos cuya procedencia y legitimidad de uso todavía se cuestionan. Pero, al fin y al cabo, una automatización de procesos y labores que ya se venía dando desde hace tiempo a través de las capacidades del dato y del machine learning.

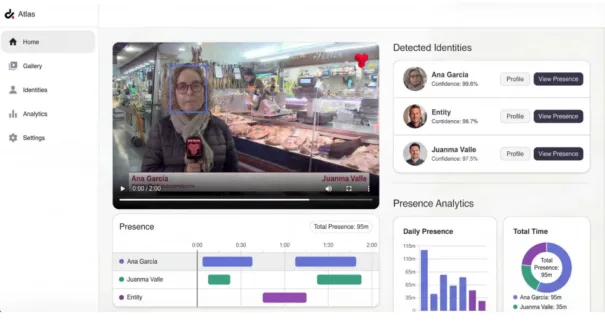

Como muestra, los procesos de metadatado, en los que motores de terceros se alimentaban de la inteligencia de las propias corporaciones para proceder a la catalogación agilizada de personajes, situaciones, lugares e incluso emociones. Ahora, estas herramientas aceleran su implementación con un “conocimiento” global del mundo.

La consultora Dive lleva trabajando años con empresas como RTVE, RTL o STC TV para enfocar la IA desde un particular prisma: no solo estudia modelos y sistemas inteligentes para resolver los desafíos del mercado, sino que atiende las necesidades de cada cliente e identifica de qué manera la IA puede abrir la puerta a nuevas posibilidades. Tras acompañar de cerca la evolución de estas herramientas, José Carlos González y Julio Albertos abordan en detalle unos conceptos que pueden resultar más o menos cercanos a los profesionales de las televisiones y productoras, pero que, en colaboración con la IA, ya están marcando el día a día de la industria: procesamiento multimodal, modelado 3D o indexación。

Nuevas posibilidades hasta ahora impensables

La evolución de la IA ha sido un camino lento, que ha alimentado a equipos de investigación y la imaginería popular desde hace décadas. La irrupción de los modelos generativos, acompañada de una industria dispuesta a abrir sus desarrollos de software a estas aplicaciones, abre la puerta a capacidades hasta ahora impensables: “Gestión, back office… Procesos que antes necesitarías a una persona dedicada al 100% pueden ser apoyados por los nuevos modelos, que tienen una cognición suficiente para empezar a solucionar problemas en el medio digital”.

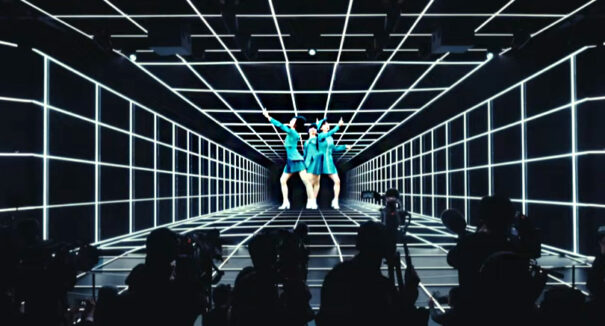

“No paran de generarse modelos. El desarrollo tecnológico está tomando una velocidad increíble y están expandiendo sus posibilidades”, apunta Albertos, quien dirige su mirada a ámbitos como el diseño y creación escenográfica: “Actualmente se puede reconstruir un plató en 3D y dentro de unos años, cuando se abarate la tecnología, el espectador podrá escoger su punto de vista. Son conceptos que hace unos años eran impensables y que están emergiendo increíblemente”.

Julio Albertos: “Actualmente se puede reconstruir un plató en 3D y dentro de unos años, cuando se abarate la tecnología, el espectador podrá escoger su punto de vista”.

Con los anuncios de ferias como IBC y NAB ampliamente dedicados a trasladar a sus clientes los beneficios de la llegada de la IA a sus ecosistemas, es cuestión de tiempo que las radiotelevisiones comiencen a aprovechar un potencial aún por explotar. En este sentido, González considera que la industria está viviendo una “aceleración” cuyo camino fue abierto por sistemas de transcripción, corrección de audio, subtitulado o traducción。

Ahora, estas capacidades de generación de contenido se extienden a ámbitos de procesamiento y ordenación de la información. Todo, gracias a un concepto que se repetirá en la conversación: el procesamiento multimodal, gracias al cual los operadores pueden tener acceso a un conocimiento, tratamiento y generación de contenido transversal en las operaciones broadcast.

¿Nuevas herramientas o nuevas versiones de las existentes?

Para adaptarse a las particularidades del broadcast, el camino de los proveedores y fabricantes ha pasado por la mejora de capacidades de los productos ya existentes. Un plugin para el MAM que interconecta un motor interno con capacidades externas, o el añadido de mejoras creativas a las funciones ya existentes de un software de postproducción, guían los primeros pasos de una industria que todavía no ha dado el paso de construir herramientas desde cero en torno a los modelos generativos.

José Carlos González: “El mercado está abarrotado de soluciones de IA que no están sustentadas por los grandes modelos. En mi opinión, la industria se va a empezar a unificar”.

Ahora, ¿llegarán? ¿La industria broadcast se abrirá a un gestor de contenidos construido 100% en base a la IA generativa, ya sean alimentada local o externamente? “Esta es la pregunta que se está haciendo toda la industria. ChatGPT, Gemini o Claude ya están trabajando para enriquecer sus funcionalidades”, explica González, quien apunta a toda una nueva generación de startups que están empezando a aplicar los principales modelos de IA en desarrollos concretos: “El mercado está abarrotado de soluciones de IA que no están sustentadas por los grandes modelos. En mi opinión, la industria se va a empezar a unificar. Seguirán surgiendo muchos aplicativos específicos para casos de uso concretos, pero las grandes empresas tecnológicas, las mismas que controlan los grandes modelos, serán quienes acabarán tomando la palabra”.

La seguridad: un salto de fe

La voluntad de gestionar internamente el conocimiento de una inteligencia artificial por parte de los broadcasters, con servidores y procesamiento interno, podría suponer un desafío entre los fabricantes que puedan apostar por la integración de los principales modelos de IA. Entre los argumentos esgrimidos por las televisiones figura tanto mantener el control de su propio contenido como cumplir con las distintas normativas de protección de datos。

González: “Las grandes empresas llevan mejor el cumplimiento de protección de datos, pero es cierto que a veces, con el uso de estas tecnologías tienes que dar un salto de fe”.

“El usuario envía y recibe información. En principio, no ves dónde está yendo esa pregunta o esa información confidencial. (…) El modelo tiene acceso a lo que transmites y nada te asegura que esa información no pueda permear al exterior de alguna manera”, comenta González, añadiendo que algunas empresas ya están ofreciendo planes o servicios para certificar la protección de datos concretos: “Las grandes empresas llevan mejor este cumplimiento, pero es cierto que a veces, con el uso de estas tecnologías tienes que dar un salto de fe”.

Existen alternativas locales, no obstante. Desde Dive, trabajan con los modelos Open Source publicados por Meta que permiten construir soluciones especificas corriendo en la infraestructura del cliente. No obstante, es necesario valorar cuestiones como el coste de la computación, el creciente precio de las GPU o el coste de los servicios cloud. Por ello, las alternativas más “seguras” en ocasiones se descartan por la propia rentabilidad: “Es mucho más económico utilizar proveedores externos a través de los servicios que ofrecen con API que tener modelos específicos que requieren entrenamiento, despliegue, industrialización y control”.

Cómo está cambiando la IA el metadatado

La IA comenzó a abrirse paso en el broadcast a través de sus sótanos. González data en 2015 la llegada de los primeros procesos de metadatado con funciones de inteligencia artificial en la industria española, con unos motores basados en aprendizaje profundo y siempre supervisados por un operador. De esta forma, la separación de escenas, la identificación de contenido o el enriquecimiento de la información comenzaron a abrirse paso.

González: “Hemos pasado de tener modelos complejos para funciones concretas, a tener un único modelo que puede extraer de forma estructurada toda la información”.

Estos motores requerían de “mucho entrenamiento” para que funcionaran con una “calidad aceptable”. Ahora, la consolidación de los últimos modelos de IA está derribando los límites de lo posible en los departamentos de documentación: “Hemos pasado de tener modelos complejos para funciones concretas, a tener un único modelo que puede extraer de forma estructurada toda la información”.

De esta forma, un modelo puede extraer minutado del contenido, temas hablados, personas que han intervenido o bloques publicitarios. Además, este proceso puede realizarse en tiempo real dependiendo de la cantidad de contenido a estructurar.

Modelado 3D: las posibilidades de los gemelos digitales

Otro ámbito de aplicación de las tecnologías de IA generativas en los entornos broadcast es la creación de gemelos digitales aplicados tanto a escenarios de series como a platós televisivos. Antes se precisaba de decenas de imágenes para hacer un mapeado del espacio, con importantes ajustes en términos de precisión. Ahora, el proceso se ha agilizado.

“Cada vez se necesitan menos imágenes para generar un espacio y poder usar ese contenido en tres dimensiones, ya sea para cuestiones de analítica o para obtener nuevos puntos de vista. (…) A su vez, puedes segmentar esos espacios para diferenciar la silla y su volumen de la persona, de modo que puedes traquear a los sujetos más fácilmente en modelos de procesado de vídeo. El cielo es el límite en este aspecto”, explica Albertos.

Estos desarrollos se basan en modelos como NeRF (Neural Radiance Fields) 哦 Gaussian Splatting, los cuales “superan con creces” las técnicas tradicionales de fotogrametría. A su vez, los espacios se pueden relacionar con los World Models, los cuales tienen conocimiento de cómo funciona “el mundo, las físicas y cualquier entorno”: “Tú le puedes pedir al modelo que recree una escena que en la realidad sea difícil de encontrar”, comenta Gónzalez sobre un sistema que podría aplicarse incluso para generar planos de b-roll.

Procesamiento multimodal: el concepto que transforma la IA en el broadcast

Muchos de los procesos descritos por González y Albertos tienen un punto en común: la capacidad de combinar diferentes procesos y enriquecer sus posibilidades para poder realizar decenas de tareas en paralelo con datos interrelacionados que se retroalimentan. En definitiva, conceptos como procesamiento de lenguaje natural, visión por computador o robótica convergen en las nuevas tecnologías de inteligencia artificial: “Al igual que una persona que desde que nace está aprendiendo a través de todos sus sentidos, como el sonido, la vista o el tacto, la IA también se está viendo enriquecida por esta multidimensionalidad y distintas fuentes de datos”.

González: “Un modelo puede ser inteligente sabiéndose todo el texto que hay en Internet, pero imagínate si también codificas toda la información y capacidades de los vídeos de YouTube, redes sociales o imágenes. Fundamentalmente aprende cómo funciona el ser humano y cuál es la información que estamos generando”.

Sin la multimodalidad, o procesamiento multimodal, los nuevos sistemas de metadatado e indexado avanzado no serían viables técnicamente: “Al añadir estas capacidades, la capacidad cognitiva de los modelos ha aumentado enormemente. Un modelo puede ser inteligente sabiéndose todo el texto que hay en Internet, pero imagínate si también codificas toda la información y capacidades de los vídeos de YouTube, redes sociales o imágenes. Fundamentalmente, aprende cómo funciona el ser humano y cuál es la información que estamos generando”, explica González.

Albertos toma como ejemplo para explicar el potencial de estos modelos, como el nuevo Marengo 3, un silencio incómodo: “Puedes preguntarle que lo busque en una retransmisión concreta. Eso antes sería imposible de buscar por imagen o por sonido por separado. El contexto de ambas partes es lo que te da como resultado ese silencio”.

El siguiente paso de la multimodalidad, advierte González, será la interacción con el mundo, con procesos aplicados a entornos de robótica que no solo tendrán la capacidad de percibir y procesar la información, sino de actuar con ella.

De la eficiencia a la creatividad

Aún con todas las posibilidades que pueda arrojar el procesamiento multimodal y la IA, González y Albertos consideran que el primer paso que deben dar los broadcasters debe ser mejorar la eficiencia de sus procesos. Después, ya llegará el momento de la creatividad。

“Pondría el foco en identificar cuáles son los consumidores de tiempo en las jornadas laborales de la gente que conforma las empresas y ver cómo se pueden solucionar esos problemas con las tecnologías”, apunta González, convencido de que esta área es en la que la IA puede demostrar con mayor solvencia su potencial. Después, llegará el momento de cambiar las reglas del juego.

Cuando llegue ese momento, quién sabe las posibilidades que habrán adquirido las herramientas de IA: “Si estos agentes y estos sistemas de inteligencia artificial nos permiten potenciarnos a la hora de destinar más tiempo a esos procesos creativos, lo que generen empresas, creadores de contenido o medios de comunicación tendrá mucha más riqueza”.

Un artículo de Sergio Julián Gómez

你喜欢这篇文章吗?

订阅我们的 通讯 你不会错过任何东西。